生成AIとはなにか?

生成AIは、これまで人間のみに可能だと思われていた「言語の読解や解釈」を、高い精度で、しかも高速でおこなえるようになったことで、世界に衝撃を与え続けている。特別な知識や技能がなくても、誰かとチャットをする時と同じ日常の言葉で、生成AIに質問したり、指示したりするだけで、回答を得て、さらに会話のやりとりを続けることができる。日本発のスタートアップ企業、Spiral.AI 代表の佐々木雄一さんによると、生成AIの大きな特徴は、これまで専門家にしかできなかったレベルの文章作成や、描画作成、音声合成、コード生成などが、プロンプトと呼ばれるテキストを書くだけで、誰にでもできるようになったことだという。その背景には、自然言語処理に特化した人工知能プログラムの一種である、大規模言語モデル(LLM)の整備がある。

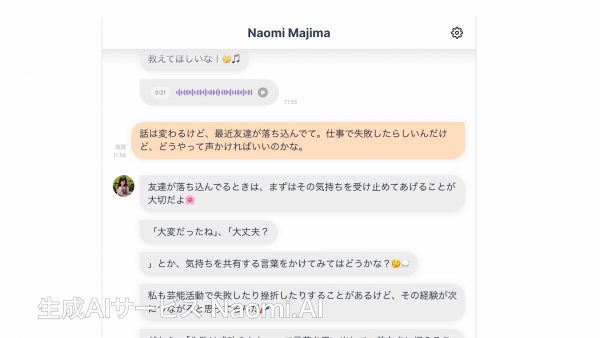

正確性よりも楽しさ重視の生成AIサービス

Spiral.AIの佐々木さんが開発した独自の生成AIサービスのひとつに、Naomi.AIがある。実在するタレントの喋り方や価値観の述懐などの音声データを大量に学習し、生成AIで作られた擬似人格キャラクターと、チャットや音声による会話コミュニケーションを楽しむことができるサービスだ。こうした技術は、生成AIが人間の代役を務められる可能性を示していると言う。例えば、コールセンタースタッフのクレーム対応や、ファンと交流するアイドルなど、感情の制御が強く求められる感情労働の現場でだ。

ホメロスに大谷翔平の詩を作ってもらう

名古屋大学の岩田直也准教授は、生成AIを西洋古典学の研究に活用できないかと共同研究を進め、西洋古典作品に特化したAI対話システム「ヒューマニテクスト」を開発した。現在、哲学者アリストテレスやプラトン、歴史家のヘロドトス、政治家で軍人のカエサルなど、22名の著者による、古代ギリシャ・ローマ時代のおよそ400作品がデータベースとして整えられている。ヒューマニテクストの大きな特徴は、どんな質問や相談が投げかけられても、正しく古典の原典に基づく回答を生成できる点だ。一般的な生成AIが抱える偽情報生成問題、いわゆるハルシネーションを回避できる点も注目される。そんなヒューマ二テクストへ、「古代ギリシアの詩人ホメロスに、メジャーリーガーの大谷翔平を英雄として讃える詩を詠んでほしい」というリクエストをすると・・・

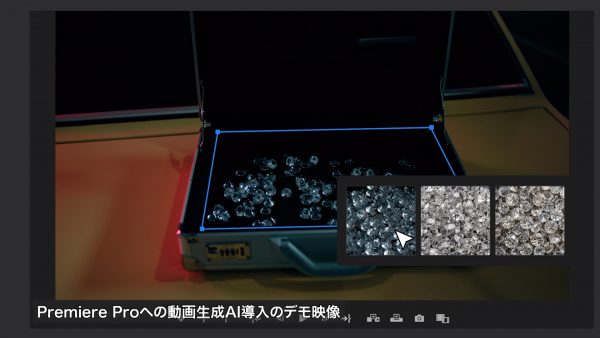

動画生成AIの衝撃と生成AIの商用利用

生成AIはいよいよ言葉による指示だけで、精度が高く、大きな破綻のない「動画」も生成することができるようになってきた。AdobeのCreative Cloud エバンジェリスト仲尾毅さんによると、2024年のうちに、Adobeの動画編集ソフトのPremiere Proで、新たに動画生成AIを使った映像が簡単に作れるようになるという。動画にせよ画像やイラストにせよ、生成AIで作られたものが、著作権侵害をしていないか?商用利用は可能なのか?という点が多くの人の関心事だが、それについてはどうなのだろうか?

法から考える、生成AIのリスクと責任の所在

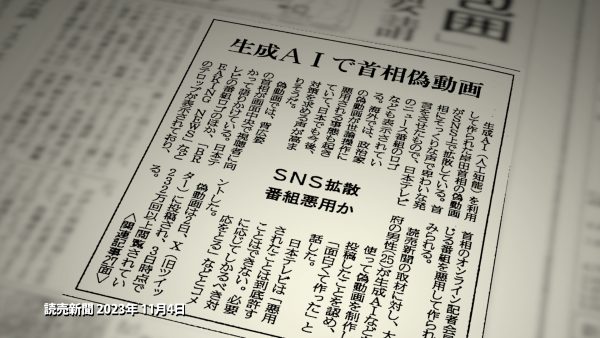

生成AIが新しいコンテンツやサービスを生み出すにつれて、これまでの社会のルールでは対応できない、未知のリスクが増えている。京都大学の羽深宏樹特任教授によると、生成AIのリスクを一気にうまく解決できるような方策は存在しないと言う。それは、人間と同じように様々なタスクをこなせてしまう今のAIに対して何か規制を作るというのは、人間の抱えるリスクを一気に解決する1本の規制を作るのと同じくらい困難なことだからだ。そして、生成AIで作られた精度の高いディープフェイクも問題となっている。2023年には岸田首相が不適切な発言をするディープフェイク画像が出回った。生成AIによって引き起こされたこれら問題の責任の主体はどこにあるのか?生成AIをコントロールできるようにするルールは作れないのか?気になるそれらについて羽深特任教授に聞いた。

主な取材先

◆佐々木 雄一さん(Spiral.AI )

◆岩田 直也さん(名古屋大学 デジタル人文社会科学研究推進センター)

◆仲尾 毅さん(Adobe)

◆羽深 宏樹さん(京都大学 法政策共同研究センター)